Akteure der Automobilindustrie sprechen häufig miteinander über die Herausforderungen und Chancen der Gründung eines auf autonome Fahrzeuge spezialisierten Unternehmens. Seltsamerweise wird kaum Zeit darauf verwendet, über den Aufbau dieser Fahrzeuge zu sprechen.

Der amerikanische LiDAR-Hersteller Ouster hat sich mit dem Thema befasst, um LiDARs speziell für solche Fahrzeuge zu entwickeln.

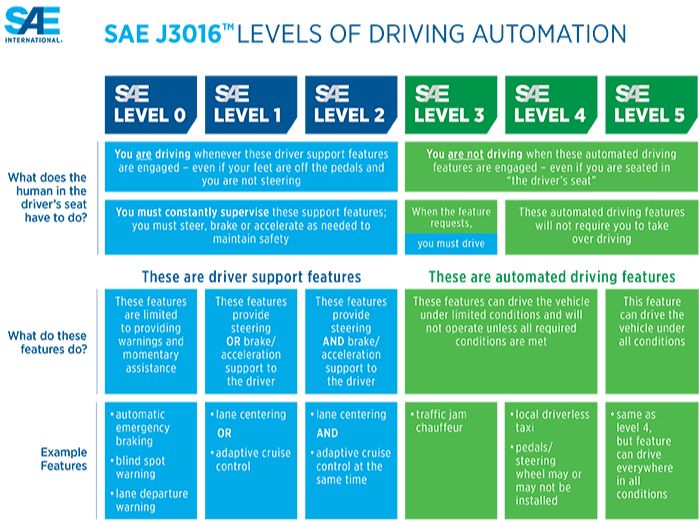

Die verschiedenen Stufen autonomer Fahrzeuge

Die Society of Automotive Engineers (SAE), die 138.000 Experten und Ingenieure aus den Bereichen Automobil und Luft- und Raumfahrt zusammenbringt, hat eine fünfstufige Skala erstellt, um den Grad der Autonomie von KI-Systemen zu klassifizieren, die in selbstfahrende Autos eingebettet sind.

Heutzutage erreichen Fahrzeuge auf dem Markt die Automatisierungsstufe 2 (manchmal auch als „2+“ bezeichnet) und sind auf ein Sensorarray bestehend aus Kameras, Front-End-Radar und niedrigauflösendem LiDAR angewiesen. Hinter dieser Sensorenausstattung verbirgt sich ein sehr einfacher Verarbeitungsstapel.

Um die Stufen 4 und 5 des SAE-Standards zu erreichen, müssen Hersteller einige hohe technische Hürden überwinden:

- Präzise Wahrnehmung und Lokalisierung in allen Arten von Umgebungen

- Schnellere Entscheidungsfindung in Echtzeit unter verschiedenen Bedingungen

- Zuverlässige und kostengünstige Systeme, die in großen Mengen vermarktet werden können

Um diese Probleme zu lösen, wäre ein Hardware-Stack mit leistungsstärkeren Sensoren und einer schnelleren Recheninfrastruktur erforderlich.

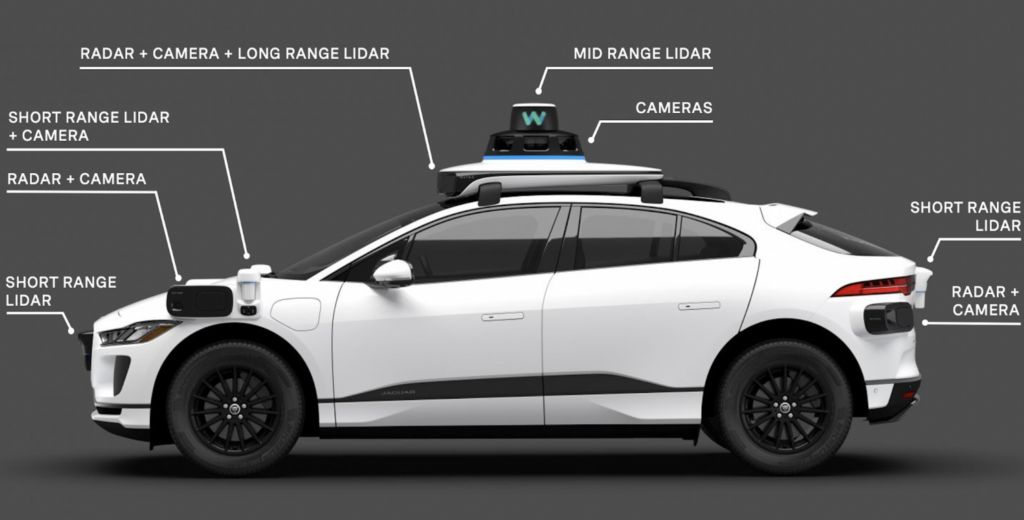

Die verschiedenen Sensoren eines autonomen Fahrzeugs

1) LiDAR

LiDAR wird aufgrund seiner Fähigkeit, genaue Tiefen- und Umgebungsinformationen bereitzustellen, in allen Prototypenfahrzeugen der Stufen 4 oder 5 eingesetzt. Diese Daten, dargestellt durch eine 3D-Punktwolke, ergänzen Daten von Kameras und Radargeräten, um Objekte um das Fahrzeug herum schneller und genauer zu klassifizieren.

Vorteile :

- Hochpräzise Tiefen-(Entfernungs-)Informationen

- Funktioniert Tag und Nacht, unabhängig von Licht- und Außenbedingungen

- Mittlere Auflösung (viel höher als Radar, niedriger als Kamera)

Nachteile :

- Hohe Datenrate

- Teure Kosten

- Größeres Format als andere Sensoren

Ein standardmäßiges autonomes Fahrzeug umfasst LiDARs mit kurzer, mittlerer und großer Reichweite, die an verschiedenen Stellen im Fahrzeug platziert sind.

Integration

- 4 Nahbereichs-LiDAR an den Kanten des Fahrzeugs, verwendet zur Identifizierung möglicher Risiken in unmittelbarer Nähe (kleine Tiere, Leitkegel, Bordsteine), die für den menschlichen Fahrer möglicherweise nicht sichtbar sind. Diese Konfiguration umfasst einen Sensor am Kühlergrill des Fahrzeugs, zwei Sensoren in der Nähe der Seitenspiegel und einen Sensor an der Heckklappe des Fahrzeugs.

- 2 LiDAR mittlerer Reichweite, schräg an den Dachkanten des Fahrzeugs angebracht, dienen Kartierung und Lokalisierung.

- 2 LiDAR mit großer Reichweite werden auf dem Dach des Fahrzeugs platziert und dienen der Erkennung dunkler Objekte und potenzieller Hindernisse bei hoher Geschwindigkeit vor dem Fahrzeug. Diese Sensoren sind im Allgemeinen zwei und können um 360° oder nach vorne ausgerichtet sein.

2) Kamera

Kameras sind traditionell der Kern des Sensorik-Stacks eines autonomen Fahrzeugs. Fahrzeuge der Stufe 4 oder 5 sind mit mehr als 20 Kameras rund um das Fahrzeug ausgestattet, die ausgerichtet und kalibriert werden, um eine 360°-Ansicht der Umgebung in sehr hoher Auflösung zu erstellen.

Vorteile :

- Hohe Auflösung und Farben in 2 Dimensionen

- Preiswert

- Einfach zu integrieren (kann fast im Auto versteckt werden)

- Sieht die Welt so, wie Menschen sie sehen

Nachteile:

- Empfindlich gegenüber wechselnden Lichtverhältnissen und widrigen Wetterbedingungen

- Die 360°-Ansicht ist sehr ressourcenintensiv (Berechnung) durch das Zusammenfügen der Bilder

3) Radar

In den letzten 15 Jahren sind Radare in Automobilanwendungen alltäglich geworden. Das Radar liefert mithilfe von Radiowellen 3D-Punktwolken seiner Umgebung.

Vorteile :

- Informationen über die Tiefe von Objekten und der Umgebung

- Billig

- Robust

- Unbeeinflusst von widrigen Wetterbedingungen (Regen, Schnee)

- Iangstrecken

Nachteile :

- Niedrige Auflösung

- Falsche negative Daten bei stationären Objekten und kritischen Hindernissen

Integration:

- Bei autonomen Fahrzeugen der Stufen 4 und 5 ist das Radar 360° um das Fahrzeug herum platziert und dient als zuverlässige Einheit zur Objekterkennung.

- Bis zu ~10 Radargeräte, einschließlich an den Seitenspiegeln, im Kühlergrill, der hinteren Stoßstange oder in den Ecken des Fahrzeugs.

Diese drei Sensoren haben jeweils ihre Vor- und Nachteile. In Kombination bilden sie jedoch einen sehr robusten Sat, der autonomes Fahren der Stufen 4 und 5 ermöglicht.

Angesichts der Anzahl der in diesen Fahrzeugen eingesetzten Sensoren ist der Verarbeitungsaufwand enorm. Schauen wir uns nun die verschiedenen Möglichkeiten an, diese Herausforderung zu meistern.

Die verschiedenen Prozessoren eines autonomen Fahrzeugs

Es gibt zwei Hauptansätze, um mit der riesigen Datenmenge umzugehen, die von allen Sensoren erzeugt wird: die zentralisierte Verarbeitung oder die verteilte Verarbeitung (Edge Computing).

1) Zentralisierte Verarbeitung

Bei der zentralen Verarbeitung werden alle Rohsensordaten an eine einzige zentrale Verarbeitungseinheit gesendet und von dieser verarbeitet.

Vorteile : Die Sensoren sind klein, kostengünstig und energieeffizient.

Nachteile:

- Erfordert teure Chipsätze mit hoher Rechenleistung und Geschwindigkeit

- Potenziell hohe Anwendungslatenz, das Hinzufügen von Sensoren erfordert zusätzliche Verarbeitungsanforderungen

2) Verteilte Verarbeitung (Edge Computing)

Beim Edge Computing werden nur die relevanten Informationen jedes Sensors an eine zentrale Einheit gesendet, wo sie zusammengestellt und zur Analyse oder Entscheidungsfindung verwendet werden.

Vorteile :

- Reduzierte Bandbreite

- Kostengünstigere Schnittstelle zwischen Sensoren und CPU

- Geringere Anwendungslatenz, weniger Rechenleistung erforderlich. Durch das Hinzufügen zusätzlicher Sensoren werden die Leistungsanforderungen nicht drastisch erhöht

Nachteile : Höhere Anforderungen an die funktionale Sicherheit

Es gibt CPUs, die sich besonders für Edge Computing eignen, wie zum Beispiel die NVIDIA Jetson Orin.

Edge Computing entwickelt sich zur Technologie der Wahl für autonome Fahrzeuge, da es die gleichzeitige Verarbeitung der wachsenden Zahl datenintensiver Sensorsignale in Echtzeit ermöglicht.

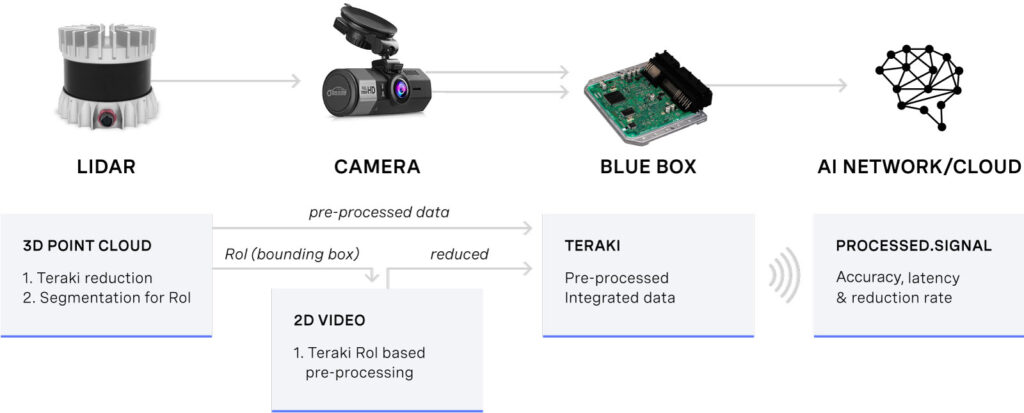

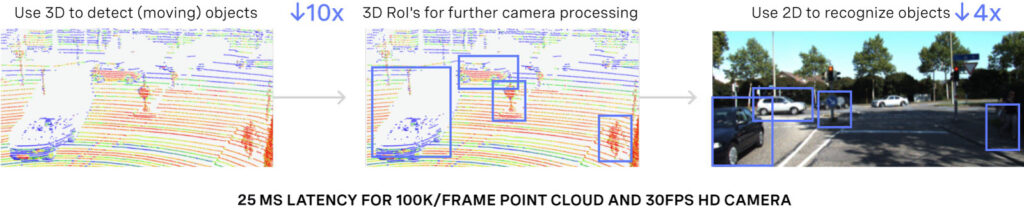

Um die Vorteile dieses Ansatzes zu veranschaulichen, nutzte Ouster die Software von Teraki, um ein Ouster LiDAR und eine HD-Kamera zusammenzuführen.

Teraki-Software, eine effiziente Lösung für die Datenverarbeitung

Der Ouster LiDAR generiert hochauflösende Punktwolkendaten, die die Umgebung um den Sensor herum abbilden. Die vom LiDAR erzeugten Informationen mit hoher Dichte (bis zu 250 Mbit/s für 128-Kanal-Sensoren) machen eine schnelle Verarbeitung für Fahrzeughardware zu schwierig.

Die Kombination dieser Informationen und der für die Videoverarbeitung erforderlichen komplexen Berechnungen, die es ermöglichen, genaue und sofortige Entscheidungen zu treffen, stellt eine große Herausforderung für autonome Fahranwendungen dar.

Die Teraki-Software löst dieses Problem durch eine intelligente Auswahl der Informationen der Sensoren. Die Software erkennt interessante Bereiche aus der 3D-Punktwolke von Ouster, komprimiert sie und übermittelt nur relevante Informationen an den Computer. Der erkannte Interessenbereich wird an die Kamera übertragen und den Videodaten überlagert.

Abschluss

Der Einsatz dieser Software und Edge Computing verbessert Kartierungs-, Lokalisierungs- und Wahrnehmungsalgorithmen. Das bedeutet: sicherere Fahrzeuge, die bessere Entscheidungen nahezu in Echtzeit treffen. Ein neuer Schritt hin zu autonomen Fahrzeugen der Stufen 4 und 5.

Der Beweis für die Wirksamkeit dieser Art von Software? Auf den Straßen von San Francisco sind kürzlich Robotertaxis aufgetaucht. Zwischen Begeisterung und Kontroverse stellt die Einführung dieser Fahrzeuge einen bedeutenden Fortschritt im Bereich des autonomen Transports dar.